David Rieu — développeur freelance

Développeur LangChain & RAG freelance

LangChain (ou des alternatives plus légères) sert à composer chaînes RAG, outils et mémoire autour des LLM. Je veille à ne pas sur-architecturer : parfois quelques fonctions bien testées et une base vectorielle suffisent pour un MVP robuste. Quand LangChain apporte de la clarté — orchestration d’outils, parsers, evaluateurs — je l’emploie avec des critères de sortie et des métriques de qualité sur vos jeux de questions réelles.

Build — preview — ship

Ils me font confiance

Ce que vous obtenez

RAG et agents maintenables

Retrieval fiable, moins d’hallucinations, coûts maîtrisés.

Chunking & métadonnées

Titres, sections, filtres — ce qui évite le bruit dans le retrieval.

Évaluation

Jeux de Q/R, scores simples avant ouverture aux utilisateurs.

Outils

SQL, API internes, avec autorisations explicites.

Simplicité

Je retire LangChain si une couche maison est plus lisible.

Lecture

LangChain : utile quand le flux mérite une orchestration explicite

Les abstractions LangChain accélèrent quand plusieurs outils et parsers s’enchaînent. Pour une seule fonction d’embedding + prompt, une lib légère suffit souvent.

La qualité du RAG se joue sur les données sources et sur la politique de citation — pas sur le nombre de chaînages.

Je documente les prompts, versions de modèles et jeux de test pour que l’équipe puisse itérer sans tout casser.

Pour vous

Profils LangChain / RAG

Produit, data, support.

Produit

Assistant sur documentation interne.

Data

Enrichissement Q/R sur catalogues.

Support

Suggestions avec validation.

Innovation

POC à industrialiser ou simplifier.

Décision

RAG durable

Qualité vs complexité.

Process

Mission RAG

- 1

01

Sources

Formats, accès, mise à jour.

- 2

02

Index

Chunking, métadonnées, vector DB.

- 3

03

Chaîne

Prompts, outils, parsers.

- 4

04

Eval

Métriques, garde-fous.

- 5

05

Prod

Monitoring, itérations données.

Stack

Stack

LangChain ou LCEL, OpenAI/Claude, Pgvector/Pinecone, Python ou TS.

Enchaînements fréquents : sur mesure, WordPress, Retour à Expertises.

Portfolio

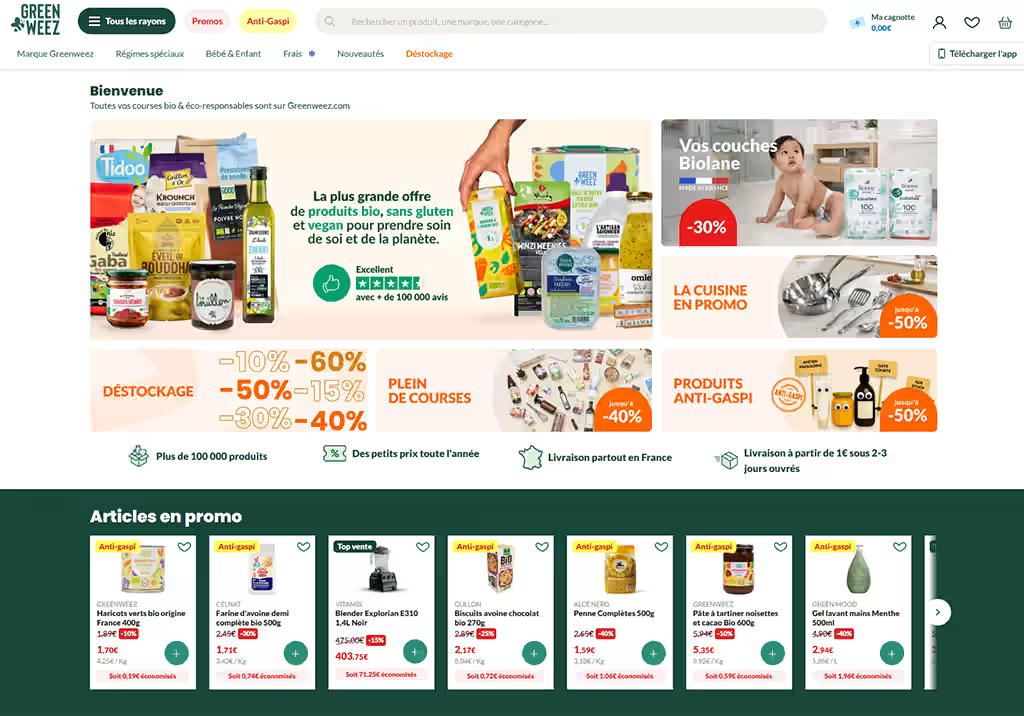

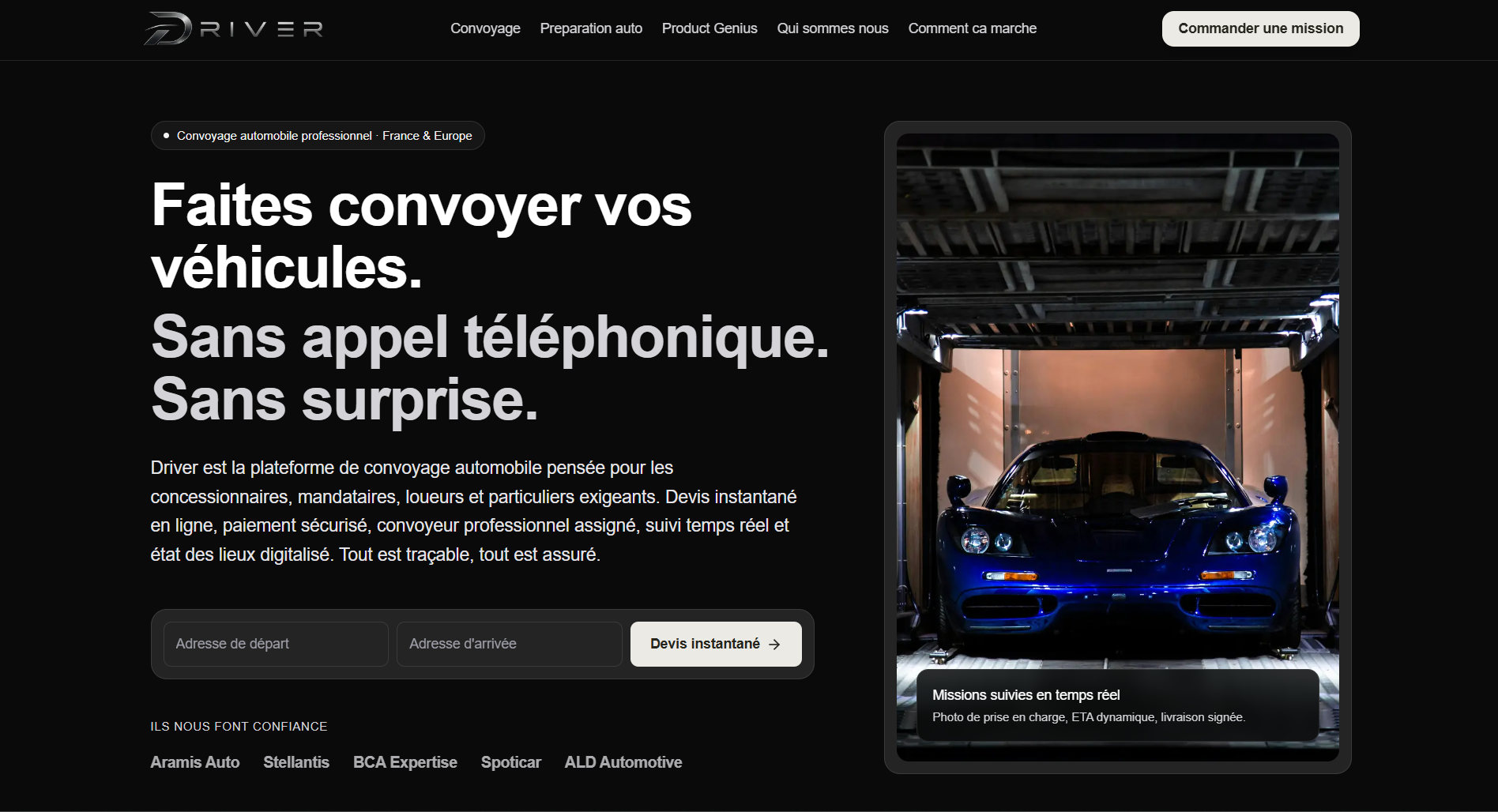

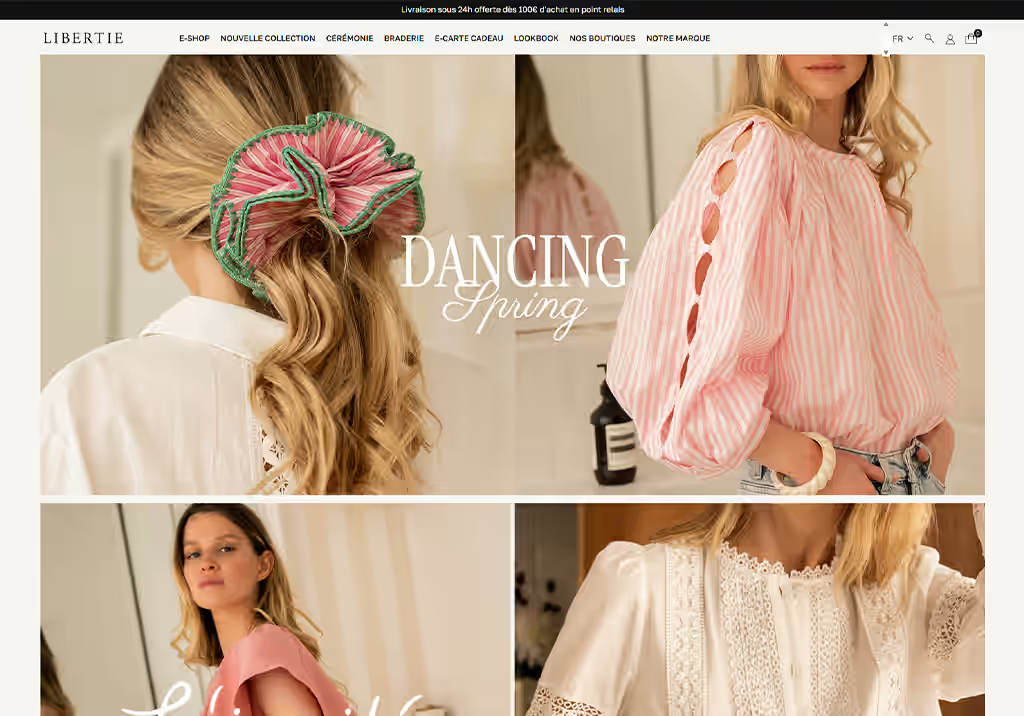

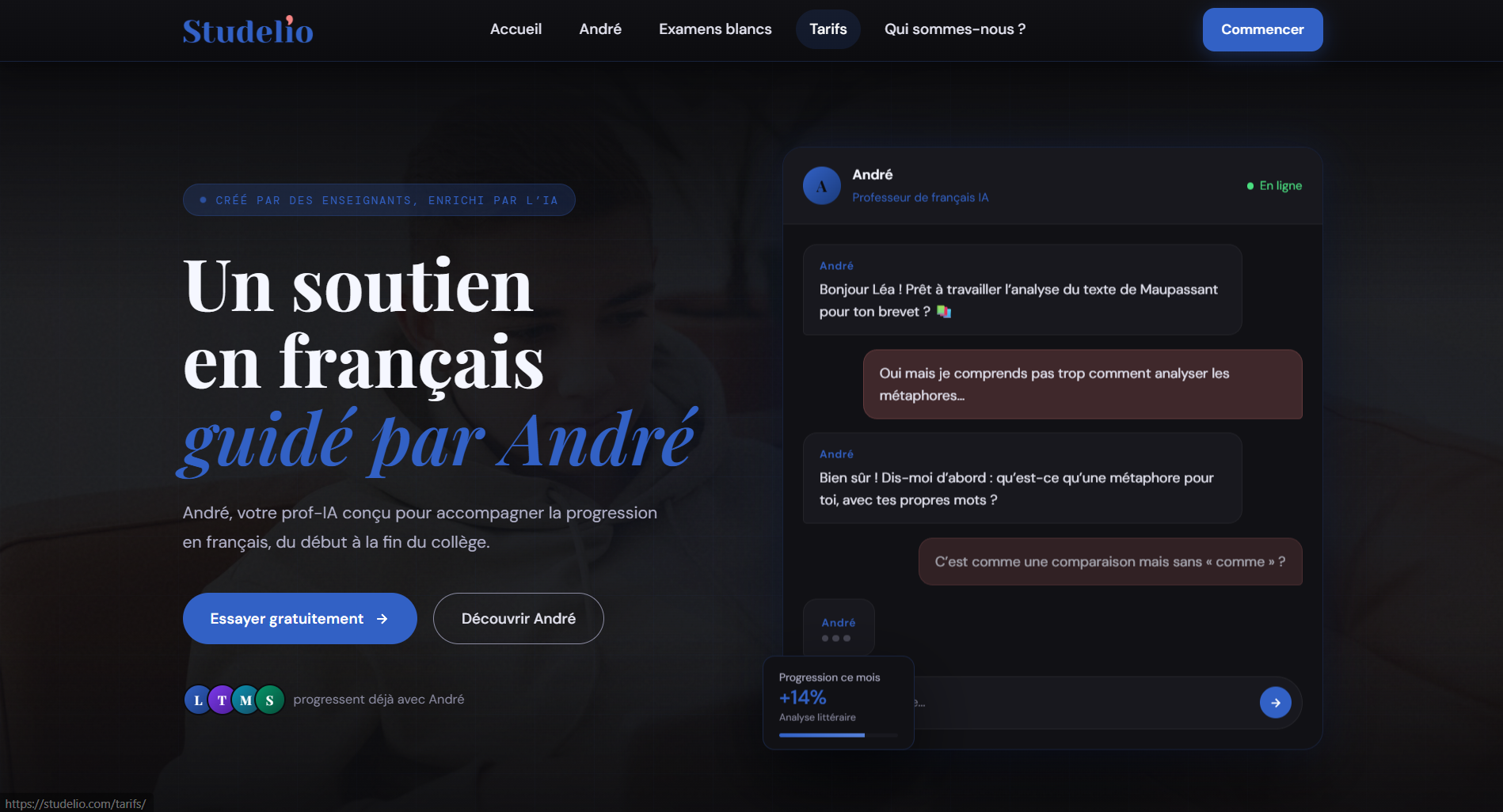

Sélection de projets

Création de sites internet, apps et outils : six projets récents. Je détaille captures et chiffres sur chaque fiche.

FAQ

FAQ — LangChain / RAG

Vector DB, coûts.

Quelle vector DB ?+

Pgvector si déjà Postgres ; Pinecone/Qdrant si besoin de scale ou features managées — coût vs ops.

LangChain obligatoire ?+

Non : parfois orchestration maison plus lisible ; je choisis selon complexité et équipe.

Reranking : quand l’ajouter ?+

Quand le retrieval renvoie trop de bruit ; un petit modèle de rerank améliore souvent la précision pour un coût maîtrisé.

Mise à jour des documents source ?+

Stratégie d’ingestion (full vs delta), horodatage des chunks, et invalidation pour éviter des réponses sur d’anciennes versions.

RAGouagentsàconcevoir?

Expliquez votre contexte en quelques lignes : proposition réaliste sous 24h ouvrées (périmètre, jalons, ordre de grandeur).

30 minutes de discussion, sans engagement. Vous repartez avec des conseils concrets, même si nous ne donnons pas suite ensemble.